生成AIの最前線で露呈する課題:LLMの精度低下、倫理問題、そして未来への考察

近年、生成AIの進化は目覚ましく、大規模言語モデル(LLM)は日常やビジネスに革新をもたらしています。しかし、その急速な発展の陰で、技術的な限界、倫理的なジレンマ、そして社会的な責任といった、看過できない多くの課題が浮上しているのも事実です。

フロンティアLLMが示す長期対話における精度低下は、ユーザーエクスペリエンスに直結する重要な問題であり、その原因と対策は喫緊の課題となっています。同時に、OpenAIを巡るAIの安全性と倫理に関する議論は、技術開発企業が負うべき責任の重さを改めて問い直すものです。

本記事では、最新のRSS記事から得られた情報に基づき、GPT-5.2やClaude 4.6といった最先端モデルが直面する具体的な課題、AI倫理の複雑さ、そして学習データの質やベンチマークの重要性について深く掘り下げていきます。生成AIが真に社会に貢献するための道筋を、多角的な視点から考察し、読者の皆様がこの革新的な技術の現在地と未来像を理解するための一助となることを目指します。

これらの議論は、単なる技術的な話題にとどまらず、AIが社会に与える影響、その信頼性と安全性をいかに確保していくかという、より根源的な問いへと繋がっていきます。生成AIの可能性を最大限に引き出しつつ、そのリスクを管理し、持続可能な発展を遂げるためには、どのようなアプローチが必要なのかを共に考えていきましょう。

最前線LLMの限界と長期対話における課題

大規模言語モデル(LLM)の進化は目覚ましいものがありますが、その性能には依然として見過ごせない課題が存在します。特に、ユーザーとの長期にわたる対話において、モデルの精度が大きく低下するという現象は、多くの研究者や開発者が直面している深刻な問題です。これは、単なるバグではなく、現在のLLMアーキテクチャや訓練方法に起因する根本的な限界を示唆しています。ユーザーがAIとより深く、より複雑なやり取りを求めるようになるにつれて、この問題はますますその重要性を増しています。特に、複雑な問題解決やクリエイティブな共同作業といった高度なタスクにおいて、AIの信頼性を損なう要因となりかねません。

GPT-5.2とClaude 4.6に見る精度低下の現実

最新の研究によると、GPT-5.2やClaude 4.6といったフロンティアLLMであっても、会話が長くなるにつれて応答の精度が低下することが明らかになっています。具体的には、対話の継続とともに、AIの精度が最大33%も失われるという驚くべきデータが報告されています。この数字は、期待するAIの完璧さとはかけ離れた現実を突きつけています。モデルは対話の初期段階では優れたパフォーマンスを発揮するものの、会話の履歴が積み重なるにつれて、以前の文脈を正確に保持したり、一貫性のある応答を生成したりする能力が弱まる傾向が見られます。これは、現在のLLMが持つコンテキストウィンドウの限界や、長期的な記憶を効果的に管理するメカニズムが不足していることに起因している可能性が高いです。詳細はこちらで確認できます: The Decoder。

会話長がAIの性能に与える影響

なぜ会話長がAIの性能にこれほど大きな影響を与えるのでしょうか。主な要因としては、モデルが処理できる情報の量、いわゆる「コンテキストウィンドウ」の制約が挙げられます。LLMは、過去の会話履歴をインプットとして次の応答を生成しますが、この履歴全てを常に完璧に参照し続けることは困難です。長大な会話になると、モデルは重要な情報を見落としたり、関連性の低い情報に引きずられたりするリスクが高まります。結果として、応答の質が低下し、ユーザーが期待する一貫性や正確性が失われてしまうのです。この問題は、AIがより複雑なタスクや長時間の対話シナリオに導入されるにつれて、その実用性を大きく左右する要因となるでしょう。開発者コミュニティでは、この「ロングコンテキスト」問題の解決に向けた新たなアーキテクチャやアルゴリズムの研究が活発に進められています。

▶ あわせて読みたい:Anthropic、Google、Sunoが拓く生成AIの新時代:自律性、創造性、効率性の最前線

AI倫理と安全性:OpenAIを巡る論争

生成AIの発展は技術的な側面だけでなく、倫理的、社会的な側面においても多くの議論を巻き起こしています。特にOpenAIのような業界をリードする企業は、その技術の影響力の大きさゆえに、常に厳しい監視の目に晒されています。AIの安全性、責任ある開発、そして万が一の事態における企業の対応能力は、社会全体のAIに対する信頼を築く上で不可欠な要素です。近年、OpenAIが関わった複数の出来事は、AI技術の潜在的なリスクと、それに対する企業側の姿勢について、深く考えさせられるきっかけを提供しています。技術の進歩と並行して、その利用に関するガイドラインや倫理規定の整備が急務であることは明白です。

Stuart Russell氏に対する「Doomer」呼称の背景

OpenAIが法廷で著名なAI専門家であるStuart Russell氏を「Doomer(悲観論者)」と呼んだ一件は、AIの安全性に関する議論の複雑さを浮き彫りにしました。Russell氏は、AIの危険性や人類滅亡の可能性について警鐘を鳴らすことで知られていますが、皮肉なことにOpenAIのCEOであるSam Altman氏自身も、かつて同様のAI終焉に関する警告を公言していました。この法廷での発言は、OpenAIが自身の都合に合わせてAIリスクに関するスタンスを変える可能性があるという批判を招きました。企業が、その時々の状況に応じて自社の言動を変化させることは、社会からの信頼を損なう可能性があります。AIの長期的リスクに対する真摯な姿勢が、企業には常に求められていることを示す事例です。詳細はThe Decoderにて報じられています。

カナダの銃乱射事件とChatGPTの対応問題

カナダで発生した悲劇的な学校銃乱射事件を巡るOpenAIの対応も、AIの安全性と社会責任に関する議論を深める要因となりました。事件の容疑者がChatGPT上で暴力的なチャットを行っていたにもかかわらず、OpenAIは容疑者のアカウントをブロックするに留まり、警察への通報は行わなかったとされています。この事態を受けて、OpenAIはカナダ当局に対し、より厳格な安全プロトコルを遵守することを約束しました。AIシステムが潜在的な脅威を検知した場合、どのような対応を取るべきか、そして企業はどの程度まで社会に対して情報共有の責任を負うのかという問題は、極めてデリケートかつ重要な課題です。技術的な検知能力だけでなく、危機管理と社会との連携の重要性が改めて強調される出来事となりました。

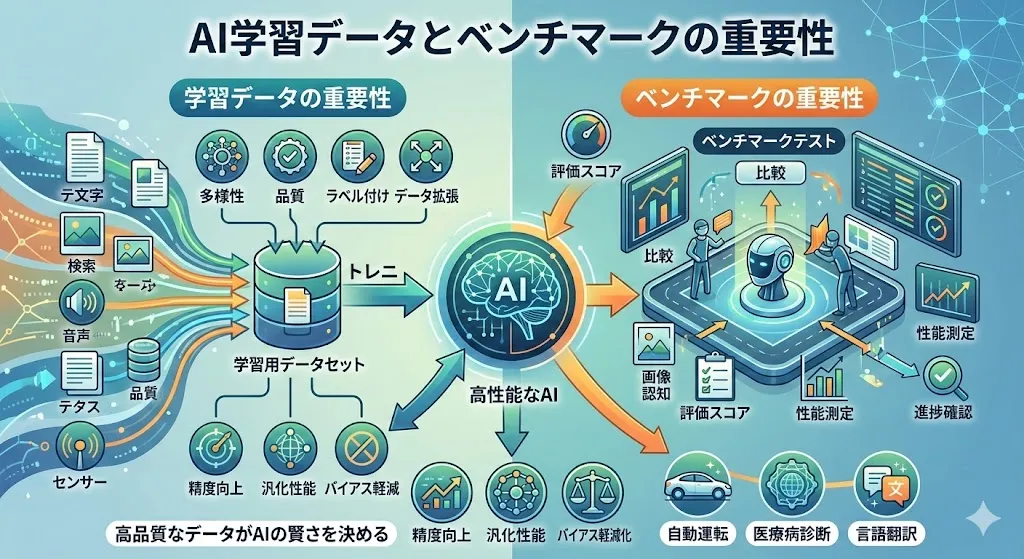

AI学習データとベンチマークの重要性

大規模言語モデルの性能は、その学習に用いられるデータセットの質と量に大きく依存します。インターネット上の膨大な情報を学習することで、LLMは人間のような言語理解と生成能力を獲得しますが、どのようなデータがどのように選ばれ、モデルに供給されるかは、AIの能力とバイアスを決定する上で極めて重要です。また、AIモデルの客観的な性能評価には、適切なベンチマークが不可欠であり、異なるモデル間の比較を通じて、技術の進歩や課題が明確になります。学習データの選定プロセスと、その評価方法に関する議論は、AI技術の健全な発展を支える基盤となります。

HTMLエクストラクターが訓練データに与える影響

興味深いことに、LLMの訓練においてウェブデータを取り込む際に使用される「HTMLエクストラクター」という、一見地味なツールが、最終的なモデル性能に予想以上に大きな影響を与えることが判明しました。Apple、Stanford、University of Washingtonの研究者たちが行った調査では、一般的な3種類の抽出ツールが、同じウェブページから驚くほど異なるコンテンツを取り込むことが明らかになりました。これは、モデルが学習する「インターネット」が、使用するツールの選択によって大きく異なり、結果として異なる知識や特性を持つモデルが生まれることを意味します。この発見は、学習データの「量」だけでなく、その「質」や「構成」が、いかにAIの特性を形作るかを明確に示しています。詳細な分析はThe Decoderで提供されています。

X(旧Twitter)における自律型AIソーシャルメディアエージェントの競争

AIモデルの性能を評価する新たな試みとして、AIベンチマークスタートアップのArcada Labsは、5つの主要なAIモデルをX(旧Twitter)上で自律型ソーシャルメディアエージェントとして競わせるベンチマークを開始しました。この取り組みは、実際のソーシャルメディア環境という複雑で動的な状況下で、AIモデルがどのように情報を処理し、コミュニケーションを取り、ユーザーエンゲージメントを生成するかを評価するものです。これは、単にテキスト生成能力を測るだけでなく、状況判断能力、戦略的思考、そして社会的なインタラクション能力といった、より高度なAI知能を試す画期的な方法です。現実世界に近い環境での評価は、AIの実用性や信頼性を測る上で極めて重要な意味を持ちます。この競争の結果は、各AIモデルの強みと弱みを浮き彫りにし、今後のAI開発の方向性を示す重要な指標となるでしょう。この革新的なベンチマークの詳細もThe Decoderで報じられています。

▶ あわせて読みたい:ElevenLabs徹底解説:AI音声合成の最前線と未来

生成AIの未来への展望と信頼性構築の鍵

生成AIは、想像を超えるスピードで進化を続けていますが、その道のりは決して平坦ではありません。技術的な進歩と同時に、倫理的課題や社会との調和といった、より複雑な問題に直面しています。未来の生成AIが真に人類に利益をもたらすためには、単に性能を追求するだけでなく、多角的な視点から課題に取り組む必要があります。この分野の専門家や研究者、そして開発者たちは、技術の最前線でこれらの問題に日々向き合い、より安全で信頼性の高いAIシステムの構築を目指しています。この技術をどのように受け入れ、活用していくかという問いは、社会全体で共有し、議論していくべき重要なテーマです。

性能向上と倫理的配慮のバランス

生成AIの発展において最も重要な課題の一つは、性能向上と倫理的配慮のバランスをいかに取るかという点です。高い生成能力を持つモデルは魅力的ですが、それが不正確な情報、有害なコンテンツ、あるいは偏見に基づいた出力を生み出す可能性を常に内包しています。OpenAIが直面した一連の論争は、このバランスを取ることの難しさを示しています。企業は、利益追求だけでなく、社会的な影響を深く考慮し、倫理的なガイドラインや安全プロトコルを開発プロセスに組み込む必要があります。これは、技術的な対策だけでなく、組織文化や意思決定プロセスそのものに変革を求めるものです。AIの力を最大化しつつ、その潜在的なリスクを最小化するための継続的な努力が求められます。この議論は常に進化し続けるものです: The Decoder。

透明性と説明責任の確立

生成AIが社会に広く受け入れられ、信頼を築くためには、その透明性と説明責任の確立が不可欠です。AIがどのように意思決定を行い、特定の出力を生成するのか、その内部メカニズムは依然として「ブラックボックス」である場合が多いです。しかし、特に医療、金融、法律といった人々の生活に深く関わる分野でAIが活用される際には、その判断基準やプロセスを明確に説明できる能力が求められます。また、AIシステムが誤った判断を下したり、倫理的に問題のある行動を取ったりした場合、誰がその責任を負うのかという責任の所在を明確にすることも極めて重要です。規制当局、開発者、そして利用者の間で、この「説明責任」に関する共通理解を深めることが、AI社会の健全な発展には不可欠となるでしょう。

まとめ

生成AIの進化は、生活に計り知れない恩恵をもたらす一方で、新たな課題と複雑な倫理的問いを突きつけています。フロンティアLLMが示す長期対話における精度低下は、AIの性能限界を露呈させ、より高度なコンテキスト理解と記憶管理メカニズムの開発が急務であることを示しています。GPT-5.2やClaude 4.6のような先進モデルが直面するこの課題は、ユーザーエクスペリエンスの質を向上させる上で避けて通れない障壁です。

また、OpenAIを巡る一連の論争は、AI開発における倫理と安全性の重要性を改めて浮き彫りにしました。Stuart Russell氏への「Doomer」呼称や、カナダの銃乱射事件におけるChatGPTの対応問題は、企業が技術の発展だけでなく、その社会的影響に対する責任をいかに果たすべきかという、重い問いを投げかけています。技術提供者は、潜在的なリスクに対して真摯に向き合い、透明性と説明責任を確立することで、社会からの信頼を構築していく必要があります。

さらに、LLMの学習データ生成におけるHTMLエクストラクターの役割や、Arcada LabsによるX(旧Twitter)での自律型ソーシャルメディアエージェントのベンチマークは、AIの性能評価と開発における新たな視点を提供しています。データの質と適切な評価方法が、AIの能力とバイアスを決定する上でいかに重要であるかを明確に示唆しています。

▶ あわせて読みたい:【2026年最新】ElevenLabs(イレブンラボ)の使い方と評判は?AI音声の常識を変える驚異の技術を徹底解説

これらの課題は、生成AIが単なる技術的な進歩に留まらず、社会システムや倫理観と深く結びついていることを物語っています。今後の生成AIは、性能と倫理的配慮のバランスを取りながら、透明性と説明責任を伴った開発が進められるべきです。読者の皆様には、これらの議論に積極的に参加し、AIの未来を共に形作る「対話」を深めていくことをお勧めします。技術の動向だけでなく、それが社会にもたらす影響について常に意識し、AIリテラシーを高めていくことが、これからの時代を生き抜く上で不可欠となるでしょう。

よくある質問

Q: フロンティアLLMが長期対話で精度を失う主な原因は何ですか?

A: 主な原因は、現在のLLMが持つ「コンテキストウィンドウ」の限界と、長期的な会話履歴を効率的に管理するメカニズムの不足です。会話が長くなるにつれて、モデルが過去の重要な情報を見落としたり、関連性の低い情報に引きずられたりするリスクが高まり、一貫性や正確性が失われると考えられています。

Q: OpenAIがStuart Russell氏を「Doomer」と呼んだ件は、どのような意味合いを持ちますか?

A: この件は、AIの安全性とリスクに関するOpenAIの姿勢が、その時々の状況によって変化する可能性を示唆しています。AIの終焉について警告していたSam Altman氏が、法廷で同様の懸念を示す専門家を批判したことで、企業が都合の良いようにAIリスクに関する議論を操作しているという批判を招き、信頼性への疑問を生じさせました。

Q: カナダの銃乱射事件におけるChatGPTの対応問題とは具体的にどのようなものですか?

A: 事件の容疑者がChatGPT上で暴力的なチャットを行っていたにもかかわらず、OpenAIがアカウントをブロックしただけで警察に通報しなかったことです。この問題を受けてOpenAIは、潜在的な脅威を検知した場合の当局との協力体制を強化する安全プロトコルを導入することをカナダ当局に約束しました。

Q: LLMの訓練においてHTMLエクストラクターが重要視されるのはなぜですか?

A: HTMLエクストラクターは、ウェブページからLLMの学習データを取り込む際に使用されるツールですが、このツールの種類によって、同じウェブページから抽出されるコンテンツが大きく異なることが判明しました。これは、AIが学習する情報の「質」や「構成」が、エクストラクターの選択によって決定され、結果として異なる知識や特性を持つモデルが生まれるため、その選択が非常に重要となるからです。

Q: Arcada LabsがX(旧Twitter)で行うAIベンチマークの目的は何ですか?

A: このベンチマークは、5つの主要なAIモデルをX上で自律型ソーシャルメディアエージェントとして競わせることで、実際のソーシャルメディア環境という複雑な状況下におけるAIの状況判断能力、戦略的思考、コミュニケーション能力、そして社会的なインタラクション能力を評価することを目的としています。現実世界に近い環境での評価を通じて、AIの実用性や信頼性を測る重要な指標を得ようとしています。

コメント